Log-Management & Analyse

Zentralisieren Sie alle Ihre Logs an einem Ort. Leistungsstarke Suche, Echtzeit-Analyse und intelligente Alarmierung helfen Ihnen, Probleme schneller zu beheben und den Systemzustand zu erhalten.

Vollständiges Log-Management

Universelle Log-Erfassung

Sammeln Sie Logs aus jeder Quelle: Server, Container, Anwendungen, Cloud-Dienste und Netzwerkgeräte.

Automatisches Parsen

Intelligentes Parsen extrahiert automatisch strukturierte Daten aus unstrukturierten Logs.

Leistungsstarke Suche

Volltextsuche mit Regex-Unterstützung. Finden Sie jeden Log-Eintrag in Millisekunden über Milliarden von Datensätzen.

Erweiterte Filterung

Filtern Sie nach Zeitbereich, Schweregrad, Quelle oder beliebigen benutzerdefinierten Feldern. Speichern Sie Filter für schnellen Zugriff.

Log-basierte Alarmierung

Setzen Sie Alarme auf Log-Muster, Fehlerraten oder beliebige Bedingungen. Werden Sie benachrichtigt, bevor Probleme eskalieren.

Metriken-Integration

Korrelieren Sie Logs mit Infrastruktur-Metriken für vollständige Observability und schnellere Fehlerbehebung.

Log-Erfassung & -Verarbeitung

Erfassungsquellen

- Syslog (RFC3164, RFC5424)

- Anwendungs-Logs (stdout, stderr)

- Container-Logs (Docker, Kubernetes)

- Cloud-Logs (AWS CloudWatch, Azure Monitor)

- Webserver-Logs (Apache, Nginx)

- Benutzerdefinierte Log-Dateien

Parsen & Strukturieren

- JSON-Parsen

- Regex-Mustererkennung

- Grok-Muster

- Benutzerdefinierte Parser

- Feldextraktion

- Datenanreicherung

Suche & Analyse

- Volltextsuche

- Regex-Abfragen

- Zeitbasierte Filterung

- Feldebenen-Suche

- Aggregationen

- Log-Analytik

Aufbewahrung & Speicherung

- Flexible Aufbewahrungsrichtlinien

- Automatische Archivierung

- Komprimierung

- Hot/Cold-Speicher

- Datenexport

- Compliance-bereit

Intelligente Log-Alarmierung

🔍 Mustererkennung

Alarmieren Sie bei bestimmten Log-Mustern, Fehlermeldungen oder verdächtigen Aktivitäten. Verwenden Sie Regex für komplexe Abgleiche.

📊 Schwellenwert-Alarme

Werden Sie benachrichtigt, wenn Fehlerraten, Anforderungszahlen oder beliebige Log-Metriken definierte Schwellenwerte überschreiten.

⚡ Echtzeit-Erkennung

Verarbeiten Sie Logs in Echtzeit und lösen Sie Alarme innerhalb von Sekunden nach kritischen Ereignissen aus.

🎯 Intelligente Gruppierung

Automatische Gruppierung verwandter Log-Alarme, um Rauschen zu reduzieren und besseren Kontext zu bieten.

Vereinheitlichte Observability

Metriken-Korrelation

Sehen Sie Logs und Metriken nebeneinander. Springen Sie sofort von einem Metrik-Anstieg zu zugehörigen Logs.

Sicherheits-Monitoring

Verfolgen Sie Authentifizierungsfehler, Zugriffsmuster und Sicherheitsereignisse in Ihrer gesamten Infrastruktur.

Metriken-Korrelation

Verbinden Sie Logs mit Infrastruktur-Metriken für vollständige Request-to-Response-Sichtbarkeit.

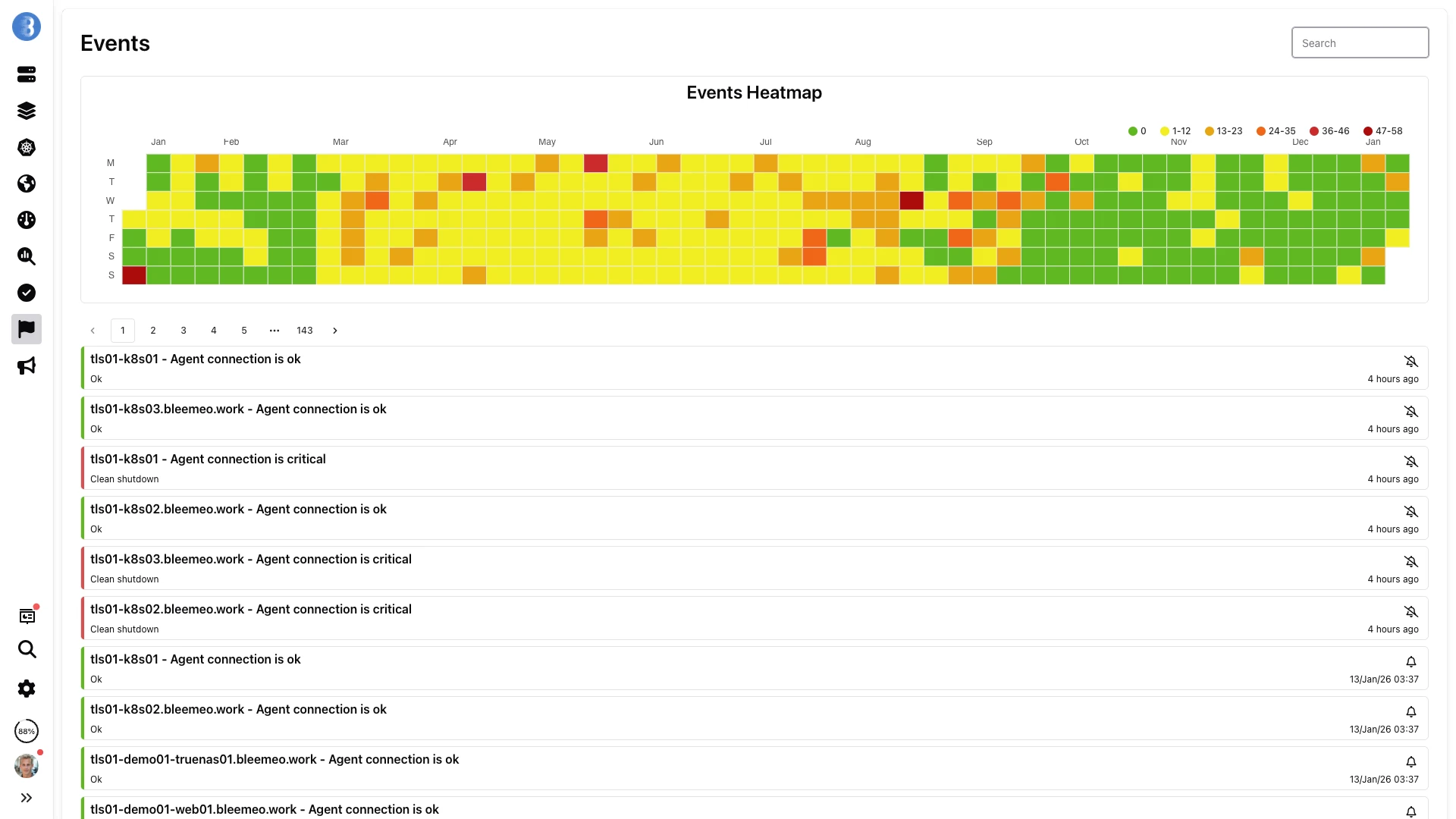

Dashboard-Integration

Fügen Sie Log-Widgets zu Ihren Dashboards hinzu. Überwachen Sie Log-Volumen, Fehlerraten und Trends visuell.

Warum zentralisiertes Log-Management?

Schnellere Fehlerbehebung

Finden Sie die Ursache von Problemen in Sekunden, nicht Stunden. Suchen Sie in allen Ihren Logs von einer einzigen Oberfläche aus.

Proaktive Erkennung

Erkennen Sie Fehler und Anomalien, bevor sie Benutzer beeinträchtigen. Alarmieren Sie bei Mustern, die auf Probleme hinweisen.

Sicherheit & Compliance

Behalten Sie Audit-Trails, verfolgen Sie Zugriffe und erfüllen Sie Compliance-Anforderungen mit zentraler Log-Speicherung.

Bessere Erkenntnisse

Analysieren Sie Trends, verstehen Sie Benutzerverhalten und optimieren Sie die Leistung mit umfassenden Log-Daten.

Was ist zentralisiertes Log-Management?

Zentralisiertes Log-Management ist die Praxis, Logs von all Ihren Servern, Anwendungen, Containern und Netzwerkgeräten in einer einzigen durchsuchbaren Plattform zusammenzufassen. Anstatt sich per SSH auf einzelne Maschinen zu verbinden und Log-Dateien zu durchsuchen, können Teams Logs ihrer gesamten Infrastruktur an einem Ort suchen, filtern und analysieren.

Mit wachsender Infrastruktur werden verstreute Logs zu einem kritischen Problem. Ein Fehler, der mehrere Dienste umfasst — ein fehlgeschlagener API-Aufruf, der einen Retry-Sturm auslöst, ein Datenbank-Timeout, das sich bis zum Frontend ausbreitet — hinterlässt Spuren in Dutzenden von Log-Dateien auf verschiedenen Hosts. Ohne Zentralisierung bedeutet das Rekonstruieren der Ereignis-Zeitachse, manuell Zeitstempel über Systeme hinweg zu korrelieren, ein Prozess, der eine 10-Minuten-Diagnose in eine mehrstündige Untersuchung verwandelt.

Zentralisiertes Logging erfüllt auch Compliance- und Audit-Anforderungen. Vorschriften wie DSGVO, HIPAA, SOC 2 und PCI-DSS verlangen häufig, dass Logs für bestimmte Zeiträume aufbewahrt, vor Manipulation geschützt und auf Anfrage zur Überprüfung verfügbar sind. Ein zentralisiertes System mit konfigurierbaren Aufbewahrungsrichtlinien, Zugriffskontrollen und unveränderlichem Speicher erfüllt diese Anforderungen weitaus zuverlässiger als einzelne Log-Dateien auf Host-Ebene, die rotiert, überschrieben oder verloren gehen können, wenn ein Server außer Betrieb genommen wird.

So funktioniert die Bleemeo Log-Pipeline

Erfassung

Der Glouton-Agent sammelt Logs aus mehreren Quellen gleichzeitig: lokale Log-Dateien (beliebiger Pfad oder Glob-Muster), Syslog (RFC3164 und RFC5424), Container-stdout/stderr (Docker, containerd, Kubernetes-Pods) und Anwendungsausgaben. In Kubernetes erkennt und sammelt Glouton automatisch Logs von allen Pods. Sie können Logs auch direkt über OTLP über gRPC oder HTTP aus Ihren Anwendungen senden.

Verarbeitung & Parsen

Logs durchlaufen eine auf OpenTelemetry Collector basierende Verarbeitungspipeline. Glouton unterstützt JSON-Parsing, Regex-Muster, Grok-Muster und benutzerdefinierte Stanza-Operatoren. Bekannte Log-Formate (nginx_access, apache_combined, syslog) werden automatisch geparst. Die Pipeline extrahiert Zeitstempel, Schweregrade und strukturierte Felder und verwandelt Rohtext in abfragbare Daten.

Filterung & Anreicherung

Vor der Übertragung können Logs mit OpenTelemetry Transformation Language-Ausdrücken, Regex-Mustern, Schweregraden oder Ressourcenattributen gefiltert werden. Sie können laute Health-Check-Logs ausschließen, Debug-Nachrichten in der Produktion verwerfen oder nur bestimmte Container einschließen. Logs werden automatisch mit Hostname, Dienstname und Container-Metadaten angereichert.

Komprimierte Übertragung

Verarbeitete Logs werden gebündelt und komprimiert, bevor sie an Bleemeo Cloud gesendet werden. Dies minimiert die Netzwerkbandbreitennutzung und gewährleistet eine zuverlässige Zustellung selbst bei eingeschränkten Verbindungen. Der Agent handhabt Wiederholungen und Gegendruck elegant und puffert Logs lokal, wenn die Verbindung vorübergehend nicht verfügbar ist.

Suche & Analyse

Im Bleemeo Cloud-Panel können Sie Volltextsuchen über alle Logs durchführen, Regex-Abfragen verwenden, nach Zeitbereich, Schweregrad, Quelle oder jedem strukturierten Feld filtern. Ergebnisse werden auch bei großen Volumen in Millisekunden zurückgegeben. Sie können häufig verwendete Abfragen speichern, Log-basierte Alarme erstellen und Logs mit Infrastruktur-Metriken in vereinheitlichten Dashboards korrelieren.

OpenTelemetry-Grundlage

Glouton bettet einen OpenTelemetry Collector in seinem Kern ein. Aktivieren Sie die Log-Pipeline mit einer einzigen Konfigurationszeile: log.opentelemetry.enable: true. Einmal aktiviert, verwendet der Agent seine integrierte Auto-Discovery, um Anwendungs-Log-Dateien, Container-stdout/stderr und dienstspezifische Log-Pfade zu erkennen. Die OTel-basierte Architektur bedeutet, dass Sie Logs auch direkt aus Ihren Anwendungen mit jedem OpenTelemetry-SDK senden können — der Agent akzeptiert OTLP über gRPC (Port 4317) und HTTP (Port 4318).

Empfänger & Eingaben

Der Agent unterstützt mehrere Log-Empfänger gleichzeitig. Der Dateiempfänger überwacht jeden Pfad oder jedes Glob-Muster (z.B. /var/log/nginx/*.log) mit automatischer Rotationsbehandlung. Der OTLP-Empfänger akzeptiert strukturierte Logs von Anwendungen über gRPC oder HTTP. Für ältere Systeme kann Fluent Bit Logs an den OTLP-Endpunkt von Glouton weiterleiten. In Docker-Umgebungen steuern Container-Labels wie bleemeo.log.enable und bleemeo.log.format das Log-Sammelverhalten pro Container ohne Änderung des Anwendungscodes.

Musterbasierte Metrik-Generierung

Definieren Sie Regex-Muster in der Glouton-Konfiguration, um Log-Zeilen in zählbare Metriken umzuwandeln. Zählen Sie beispielsweise Zeilen, die level=ERROR entsprechen, um eine Fehlerrate-Metrik zu erstellen, oder extrahieren Sie HTTP-Statuscodes aus Zugriffsprotokollen, um 4xx- und 5xx-Raten im Zeitverlauf zu verfolgen. Diese log-abgeleiteten Metriken erscheinen in Dashboards neben Infrastruktur-Metriken und schließen die Observability-Lücke zwischen Logs und Monitoring ohne Anwendungsänderungen.

Kubernetes-Log-Integration

Bei Bereitstellung als DaemonSet erfasst Glouton automatisch stdout/stderr von allen Pods. Pod-Annotationen geben Ihnen feinkörnige Kontrolle: glouton.log_enable: "false" schließt laute Pods aus, glouton.log_format gibt den Parser an (z.B. json, nginx_access), und glouton.log_filter wendet Schweregrad- oder Regex-Filter pro Pod an. Namespace-Standardwerte können in der Glouton-ConfigMap festgelegt werden, sodass Teams Log-Richtlinien für ihre Namespaces unabhängig definieren können.

Unterstützte Log-Quellen im Detail

Dateibasierte Logs

Überwachen Sie jede Log-Datei nach Pfad oder Glob-Muster. Glouton verfolgt Dateien effizient und handhabt automatisch Dateirotation und -trunkierung. Unterstützt mehrzeilige Log-Einträge für Stack-Traces und Ausnahmeblöcke. Ideal für Anwendungslogs, Webserver-Zugriffs-/Fehlerprotokolle und benutzerdefinierte Anwendungsausgabedateien.

Container-Logs

Automatisches Sammeln von stdout/stderr aller Docker- und Kubernetes-Container. In Kubernetes verwenden Sie Pod-Annotationen (glouton.log_enable, glouton.log_format, glouton.log_filter) zur Steuerung des Verhaltens pro Pod. Containername, Image und Labels werden als Metadaten für die Filterung im Dashboard angehängt.

Syslog

Empfangen Sie Logs über das Syslog-Protokoll (RFC3164 und RFC5424) über UDP oder TCP. Konfigurieren Sie Ihre Netzwerkgeräte, Firewalls und Legacy-Systeme, um Syslog an Glouton weiterzuleiten. Facility und Schweregrad werden automatisch geparst. Dies ist die Standardmethode zum Sammeln von Logs aus Infrastruktur, die moderne Log-Protokolle nicht unterstützt.

OTLP (OpenTelemetry)

Senden Sie Logs direkt aus Ihren Anwendungen mit dem OpenTelemetry-SDK über OTLP über gRPC oder HTTP. Dies gibt Ihnen volle Kontrolle über Log-Struktur, Schweregrad und Attribute auf Anwendungsebene. OTLP ist der moderne Standard für Telemetriedaten und integriert sich nahtlos in Bleemeos OpenTelemetry-native Pipeline.

Anwendungsfälle

Anwendungs-Debugging

Suchen Sie über alle Anwendungsinstanzen hinweg, um die genaue Anfrage zu finden, die einen Fehler ausgelöst hat. Korrelieren Sie Anwendungslogs mit Datenbankabfrage-Logs und Infrastruktur-Metriken, um zu identifizieren, ob die Ursache im Code, in der Datenschicht oder im zugrunde liegenden Server liegt.

Sicherheitsaudit

Zentralisieren Sie Authentifizierungslogs, Zugriffsprotokolle und System-Audit-Trails. Erkennen Sie Brute-Force-Anmeldeversuche, nicht autorisierte Zugriffsmuster und verdächtige Rechteeskalationen in Ihrer gesamten Infrastruktur. Bewahren Sie Logs für forensische Analysen nach Sicherheitsvorfällen auf.

Compliance & Aufbewahrung

Erfüllen Sie die Log-Aufbewahrungsanforderungen von DSGVO, HIPAA, SOC 2 und PCI-DSS mit konfigurierbaren Aufbewahrungsrichtlinien. Zentralisierter, unveränderlicher Speicher stellt sicher, dass Logs nicht manipuliert oder versehentlich auf einzelnen Hosts gelöscht werden können.

Metriken aus Logs

Generieren Sie benutzerdefinierte Metriken aus Log-Mustern — zählen Sie Fehler pro Sekunde, verfolgen Sie bestimmte Ereignisraten oder messen Sie Anfragelatzenzen aus Zugriffsprotokollen. Diese log-abgeleiteten Metriken erscheinen in Dashboards neben Infrastruktur-Metriken und schließen die Lücke zwischen Logs und Monitoring.

Kubernetes-Fehlerbehebung

Sammeln Sie automatisch Logs von allen Pods, wenn Glouton über Helm bereitgestellt wird. Korrelieren Sie Pod-Logs mit Container-Neustart-Ereignissen, Ressourcendruck und Knotenbedingungen. Identifizieren Sie schnell die Log-Nachricht, die einem CrashLoopBackOff oder OOMKilled vorausging.

Leistungsanalyse

Analysieren Sie Zugriffsprotokolle, um langsame Endpunkte, Seiten mit hoher Fehlerrate und Verkehrsmuster zu identifizieren. Kombinieren Sie Webserver-Logs mit Anwendungs- und Datenbankprotokollen, um Leistungsengpässe vom Frontend bis zur Abfrageschicht nachzuverfolgen.

Best Practices für Log-Management

Verwenden Sie strukturiertes Logging

Geben Sie Logs in JSON oder anderen strukturierten Formaten statt in Klartext aus. Strukturierte Logs sind einfacher zu parsen, filtern und abzufragen. Felder wie Zeitstempel, Schweregrad, Dienstname, Anfrage-ID und Benutzer-ID werden zu erstklassigen Elementen, die unabhängig indiziert und durchsucht werden können, und verwandeln die Log-Analyse von Zeichenkettenabgleich in datenbankähnliche Abfragen.

Setzen Sie konsistente Schweregrade

Übernehmen Sie eine konsistente Schweregradskala für alle Dienste (DEBUG, INFO, WARN, ERROR, FATAL). Ein "Error" in einem Dienst sollte dasselbe bedeuten wie in einem anderen. Diese Konsistenz ermöglicht dienstübergreifendes Filtern — zeigen Sie mir alle ERROR- und FATAL-Logs der letzten Stunde über alle Dienste hinweg — und verhindert, dass wichtige Nachrichten im Rauschen untergehen.

Filtern Sie Rauschen an der Quelle

Health-Check-Endpunkte, Load-Balancer-Probes und Debug-Nachrichten können enorme Mengen an wertarmen Logs erzeugen. Verwenden Sie die Filterfunktionen von Glouton, um diese auf Agent-Ebene auszuschließen, bevor sie Bandbreite und Speicher verbrauchen. Dies reduziert Kosten und hält Ihre Log-Suchergebnisse auf bedeutsame Ereignisse fokussiert.

Korrelieren Sie Logs mit Metriken

Ein CPU-Anstieg wird verwertbar, wenn Sie die Log-Nachrichten sehen können, die ihm vorausgingen. Aktivieren Sie sowohl Metrik- als auch Log-Sammlung auf demselben Agenten und verwenden Sie Bleemeos vereinheitlichte Dashboards, um sie nebeneinander anzuzeigen. Diese Korrelation verwandelt Fehlerbehebung von einem Ratespiel in eine gezielte Untersuchung.

Alarmieren Sie bei Log-Mustern

Warten Sie nicht darauf, dass jemand Logs manuell durchsucht — konfigurieren Sie Alarme für kritische Muster. Alarmieren Sie, wenn "OutOfMemoryError" in Java-Logs erscheint, wenn der Schweregrad "FATAL" N pro Minute überschreitet oder wenn eine bestimmte Fehlermeldung zum ersten Mal auftritt. Proaktive log-basierte Alarmierung erkennt Probleme auf Anwendungsebene, die Infrastruktur-Metriken allein nicht identifizieren können.

Möchten Sie mehr erfahren?

Dokumentation lesenHäufig gestellte Fragen

Alles, was Sie über Bleemeos Log-Management wissen müssen

Von welchen Log-Quellen kann ich sammeln?

Bleemeo kann Logs von praktisch jeder Quelle sammeln. Dazu gehören: Log-Dateien (jeder Dateipfad oder jedes Muster), Syslog (RFC3164 und RFC5424), Container-Logs (Docker, containerd, Kubernetes-Pods), Anwendungs-stdout/stderr und Logs, die über OTLP über gRPC oder HTTP gesendet werden. Glouton erkennt und sammelt automatisch Logs von laufenden Containern und Diensten, wenn Auto-Discovery aktiviert ist.

Wie parst und strukturiert Bleemeo meine Logs?

Glouton verwendet eine auf OpenTelemetry Collector basierende Log-Verarbeitungspipeline. Es unterstützt JSON-Parsing, Regex-Mustererkennung, Grok-Muster und benutzerdefinierte Parser mit Stanza-Operatoren. Sie können bekannte Log-Formate (wie nginx_access, apache_combined) definieren und auf Dateien, Container oder Dienste anwenden. Das System extrahiert automatisch Zeitstempel, Schweregrade und strukturierte Felder.

Kann ich bestimmte Logs filtern oder ausschließen?

Ja, Bleemeo bietet leistungsstarke Filterfunktionen. Sie können Logs mit OpenTelemetry Transformation Language-Ausdrücken, Regex-Mustern auf Log-Bodies oder -Attributen, Schweregraden und Ressourcenattributen filtern. Filter können Logs basierend auf mehreren Bedingungen ein- oder ausschließen. Sie können die Log-Sammlung für bestimmte Container auch mit dem Label glouton.log_enable=false deaktivieren.

Wie durchsuche ich Logs in Bleemeo?

Bleemeo bietet eine leistungsstarke Suchoberfläche im Cloud-Panel. Sie können Volltextsuchen über alle Ihre Logs durchführen, Regex-Abfragen für komplexe Mustersuche verwenden, nach Zeitbereich, Schweregrad, Quelle oder jedem strukturierten Feld filtern. Suchergebnisse werden in Millisekunden zurückgegeben, selbst bei großen Volumen von Log-Daten. Sie können häufig verwendete Abfragen auch für schnellen Zugriff speichern.

Kann ich Alarme basierend auf Log-Mustern einrichten?

Ja, Bleemeo unterstützt log-basierte Alarmierung. Sie können Alarme erstellen, die durch bestimmte Log-Muster, Fehlermeldungen oder Regex-Übereinstimmungen ausgelöst werden. Sie können auch bei Schwellenwertbedingungen alarmieren, wie wenn eine Fehlerrate eine bestimmte Anzahl pro Minute überschreitet. Alarme werden in Echtzeit verarbeitet, sodass Sie innerhalb von Sekunden benachrichtigt werden, wenn ein kritisches Log-Ereignis auftritt.

Wie lange werden meine Logs aufbewahrt?

Die Log-Aufbewahrung hängt von Ihrem Plan ab und kann an Ihre Anforderungen angepasst werden. Bleemeo unterstützt flexible Aufbewahrungsrichtlinien mit automatischer Archivierung und Komprimierung. Hot-Storage hält aktuelle Logs sofort zugänglich, während ältere Logs in Cold-Storage verschoben werden können. Dies ermöglicht es Ihnen, Suchleistung mit Speicherkosten auszubalancieren und gleichzeitig Compliance-Anforderungen einzuhalten.

Kann ich Logs mit Metriken korrelieren?

Ja, dies ist eine Kernstärke von Bleemeos vereinheitlichtem Observability-Ansatz. Sie können Logs und Metriken nebeneinander in Dashboards anzeigen, von einer Metrikanomalie direkt zu verwandten Logs springen und den vollständigen Kontext eines Problems an einem Ort sehen. Diese Korrelation ermöglicht schnellere Fehlerbehebung, indem Infrastruktur-Metriken neben Anwendungslogs bereitgestellt werden.

Wie sammle ich Logs aus Kubernetes?

Wenn Glouton in Kubernetes bereitgestellt wird (über das Helm-Chart), erkennt und sammelt es automatisch Logs von allen Pods. Sie können die Log-Sammlung pro Pod über die Annotation glouton.log_enable steuern. Benutzerdefinierte Log-Formate und Filter können über Pod-Annotationen (glouton.log_format, glouton.log_filter) oder über die Glouton-Konfiguration angewendet werden. Container-stdout/stderr-Logs werden ohne zusätzliche Konfiguration erfasst.

Welche Auswirkungen hat die Log-Sammlung auf die Leistung?

Die Log-Verarbeitung von Glouton ist leichtgewichtig und effizient konzipiert. Sie verwendet eine Streaming-Architektur, die Logs inkrementell verarbeitet, ohne ganze Dateien in den Speicher zu laden. Die Log-Übertragung wird gebündelt und komprimiert, um den Netzwerk-Overhead zu minimieren. Für Szenarien mit sehr hohem Volumen können Sie Filter verwenden, um das Volumen der an die Cloud gesendeten Logs zu reduzieren, während die lokale Verarbeitung minimal bleibt.

Kann ich Metriken aus meinen Logs generieren?

Ja, Bleemeo kann Metriken aus Log-Mustern erstellen. Durch die Definition von Regex-Mustern in Ihrer Konfiguration zählt Glouton übereinstimmende Log-Zeilen und stellt sie als Metriken bereit (z.B. Fehler pro Sekunde, bestimmte Ereignisraten). Dies ermöglicht es Ihnen, auf log-abgeleitete Metriken zu alarmieren, Trends im Zeitverlauf zu verfolgen und Log-Muster in Dashboards neben Ihren Infrastruktur-Metriken zu visualisieren.

Starten Sie noch heute mit dem Log-Management

Richten Sie zentralisiertes Logging in wenigen Minuten ein. Keine komplexe Konfiguration erforderlich.

Kostenlose Testversion starten